핵심 요약

- AI 모델 출시 기준이 바뀌고 있습니다. 이제는 “성능이 얼마나 좋은가”뿐 아니라 “출시 전에 위험을 얼마나 검증했는가”도 중요해지고 있습니다.

- NIST 산하 CAISI는 2026년 5월 5일 Google DeepMind, Microsoft, xAI와 프론티어 AI 테스트 협력을 발표했습니다.

- 이 흐름은 모든 AI 모델이 곧바로 정부 심사를 받게 된다는 뜻은 아닙니다. 다만 고성능 AI 모델을 출시하기 전, 보안과 국가 안보 리스크를 더 체계적으로 점검하려는 방향이 뚜렷해지고 있습니다.

- 핵심은 규제 공포가 아니라 배포 절차의 변화입니다. 프론티어 AI 모델도 소프트웨어처럼 출시 전 보안 점검, 레드팀, 문서화, 배포 후 모니터링을 요구받는 시대로 이동하고 있습니다.

목차

먼저 답부터: AI 모델도 출시 전 검증이 중요해지고 있습니다

AI 모델도 출시 전 보안 심사를 받는 시대가 오고 있습니다. 다만 이 말은 모든 AI 서비스가 곧바로 정부 허가를 받아야 한다는 뜻은 아닙니다. 현재 확인되는 핵심은 고성능 AI 모델, 특히 프론티어 AI 모델을 공개하기 전에 보안과 국가 안보 위험을 더 일찍 점검하려는 움직임이 커지고 있다는 점입니다.

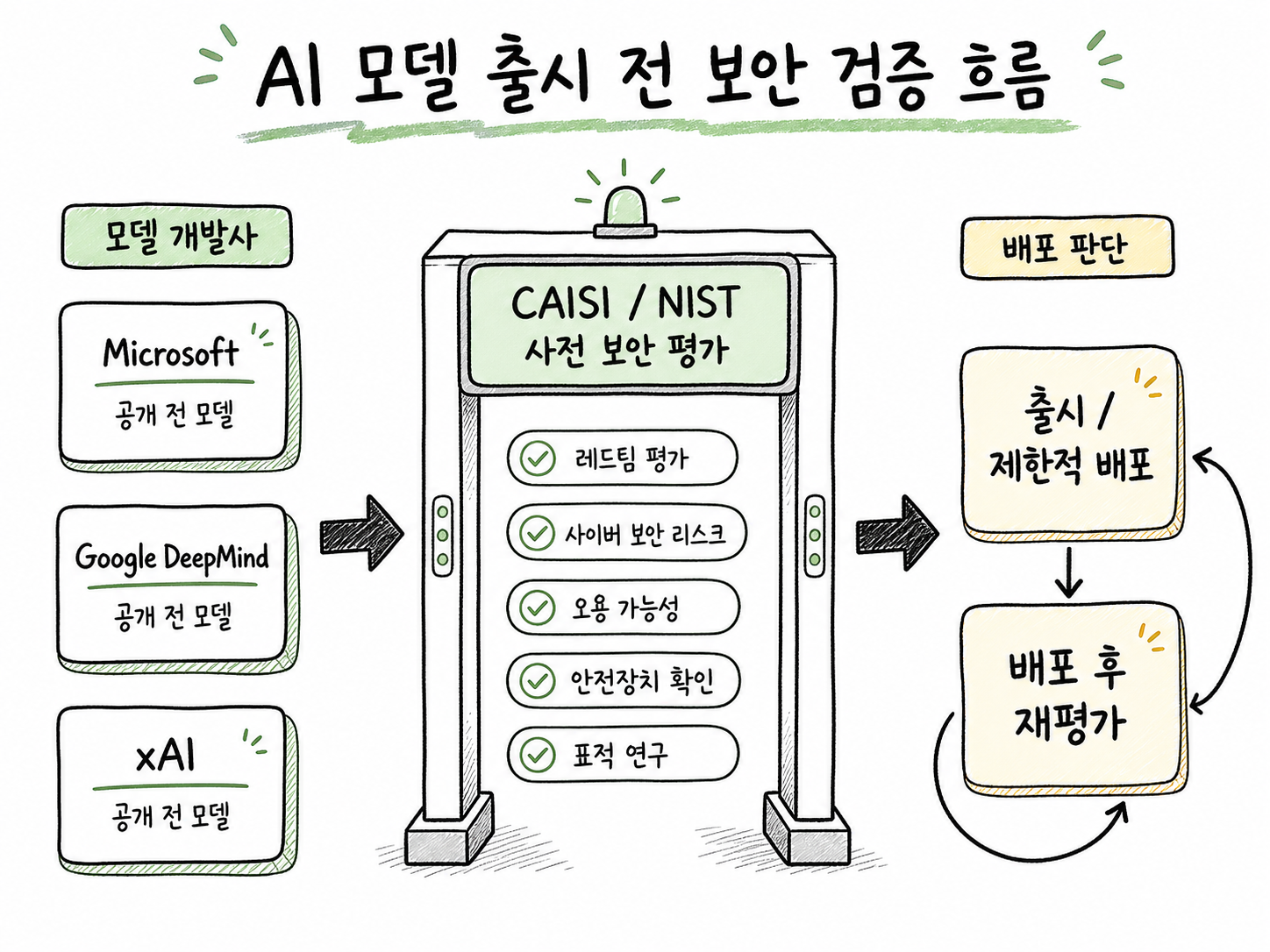

NIST는 공식 발표에서 CAISI가 Google DeepMind, Microsoft, xAI와 프론티어 AI 국가안보 테스트 협약을 체결했다고 밝혔습니다. Reuters도 2026년 5월 5일 보도에서 Microsoft, Google, xAI가 공개 전 AI 모델에 대한 미국 정부의 조기 접근을 제공해 국가 안보 리스크 점검을 지원할 예정이라고 전했습니다.

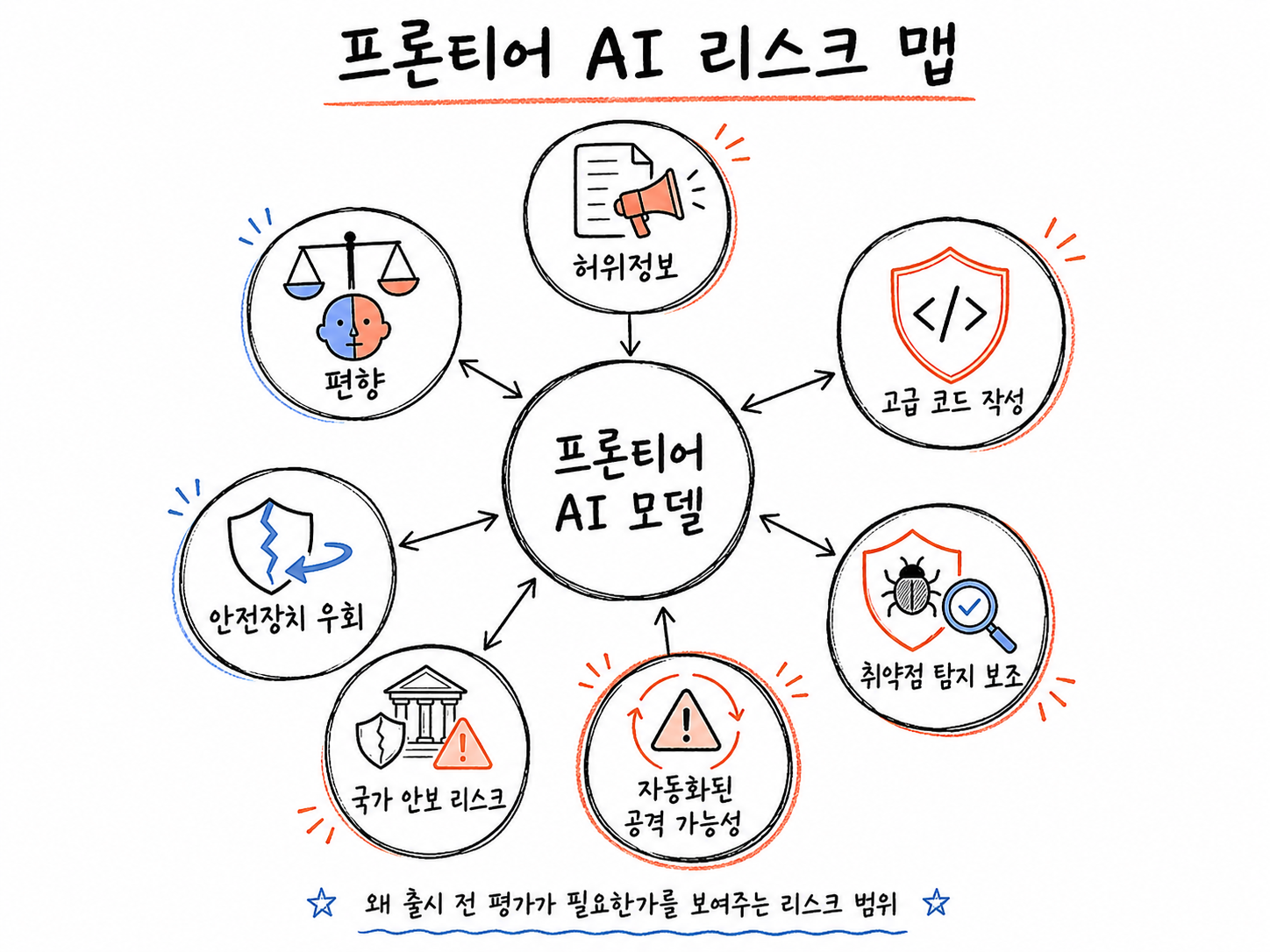

이 변화가 중요한 이유는 AI 모델이 더 이상 단순한 챗봇이나 업무 도구로만 쓰이지 않기 때문입니다. 최신 AI 모델은 코드 작성, 보안 분석, 자동화, 데이터 검색, 내부 도구 호출까지 연결될 수 있습니다. 즉, 모델이 똑똑해질수록 편리함도 커지지만 잘못 쓰였을 때의 위험도 함께 커집니다.

그래서 이 글의 핵심은 “AI 규제가 무조건 강해진다”가 아닙니다. 더 정확히는 “AI 모델 출시 절차가 소프트웨어 보안 배포 절차와 비슷해지고 있다”입니다. 앞으로 AI 모델을 만들거나 도입하는 기업은 성능표만 볼 것이 아니라, 이 모델이 어떤 방식으로 테스트됐고 어떤 위험 대응 체계를 갖췄는지도 함께 봐야 합니다.

Microsoft, Google DeepMind, xAI의 공개 전 AI 모델이 CAISI/NIST 사전 보안 평가 게이트를 거쳐 배포 판단과 배포 후 모니터링으로 이어지는 흐름도

사실 확인: 확정된 제도와 논의 중인 흐름은 구분해야 합니다

이번 발표의 주체는 미국 상무부 산하 NIST에 있는 CAISI입니다. CAISI는 Center for AI Standards and Innovation의 약칭입니다. NIST는 2026년 5월 5일 Google DeepMind, Microsoft, xAI와 프론티어 AI 국가안보 테스트 협약을 체결했다고 공식 발표했습니다.

여기서 주의할 점은 표현입니다. Reuters 보도에서는 “Google”이라고 표현했지만, NIST 공식 발표에서는 “Google DeepMind”로 표기했습니다. 또한 공개 자료만으로 이 협력이 특정 모델 하나를 대상으로 한다고 단정할 수는 없습니다. 따라서 “공개 전 AI 모델 평가 협력” 또는 “프론티어 AI 평가 협력”이라고 쓰는 편이 안전합니다.

또 하나 구분해야 할 부분은 백악관의 공식 검토 절차입니다. Reuters의 2026년 5월 4일 보도는 New York Times 보도를 인용해 백악관이 새로운 AI 모델의 정부 검토 절차를 검토 중이라고 전했습니다. 하지만 백악관 관계자는 이를 확인하거나 부인하지 않았습니다. 따라서 현재는 “확정된 제도”가 아니라 “검토 중인 정책 방향”으로 보는 것이 정확합니다.

관련 기준으로는 NIST의 AI Risk Management Framework와 생성형 AI용 문서인 NIST AI 600-1을 참고할 수 있습니다. 다만 이 문서들은 특정 모델을 승인하거나 금지하는 기준이라기보다, 조직이 AI 위험을 어떻게 관리할지 정리해 둔 참고 프레임워크에 가깝습니다.

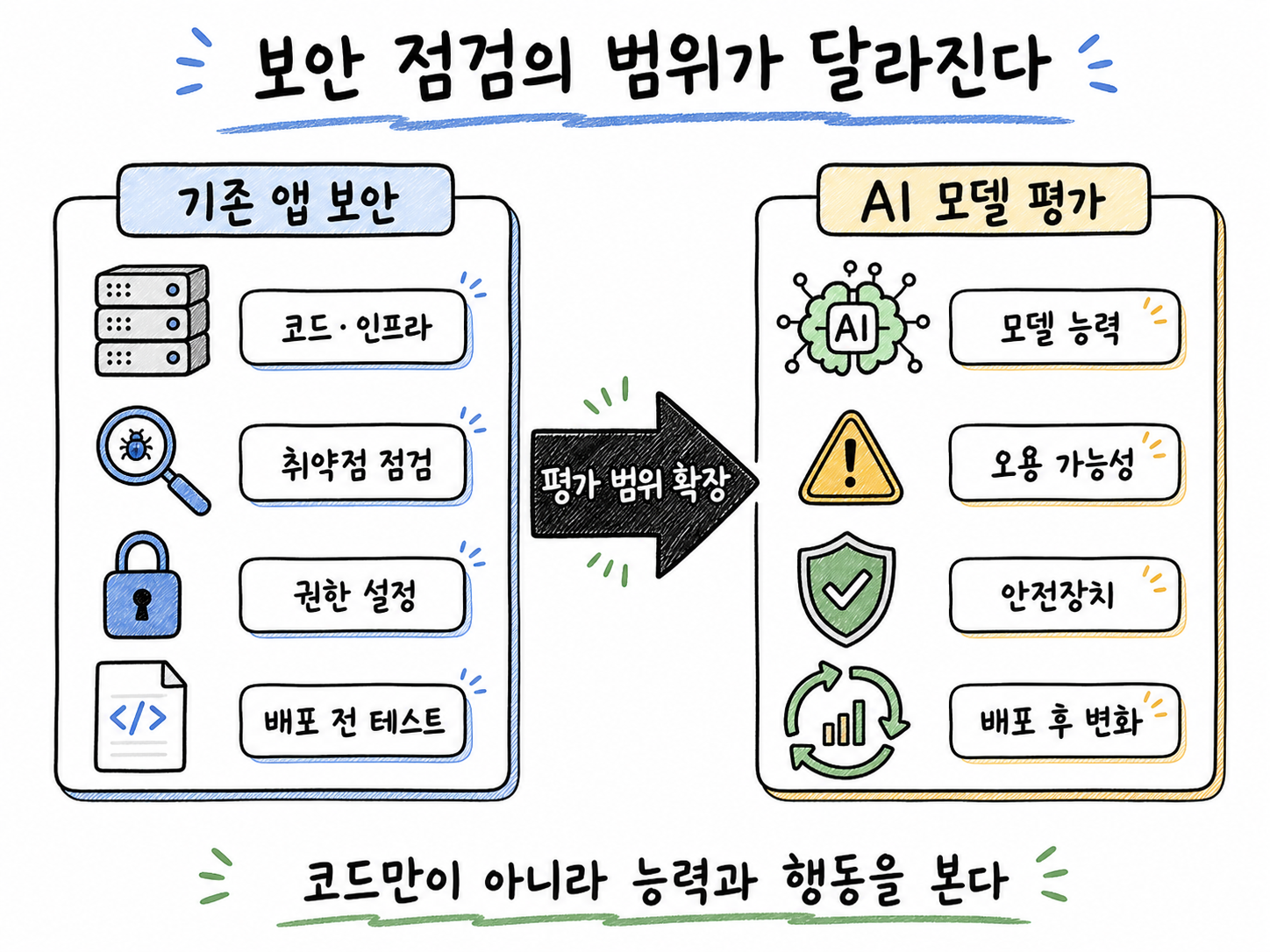

기존 앱 보안 심사와 AI 모델 사전 평가의 평가 범위가 코드에서 모델 능력, 오용 가능성, 안전장치, 배포 후 변화로 확장되는 비교 다이어그램

핵심 내용 설명: AI 모델은 코드뿐 아니라 능력 자체가 위험 평가 대상입니다

일반 소프트웨어의 보안 점검은 비교적 익숙합니다. 배포 전에 코드 취약점이 있는지, 인증과 권한 설정이 안전한지, 외부 라이브러리에 알려진 문제가 없는지 확인합니다. 쉽게 말해 “이 앱이 해킹당하기 쉬운 구조인가”를 보는 과정입니다.

AI 모델은 여기서 한 단계 더 복잡합니다. AI 모델의 위험은 코드에만 있지 않습니다. 모델이 어떤 질문에 어떻게 답하는지, 어떤 수준의 코드를 만들 수 있는지, 보안 취약점을 설명하거나 찾아내는 능력이 어느 정도인지, 안전장치를 우회하려는 요청에 어떻게 반응하는지도 중요합니다.

예를 들어 코딩을 잘하는 모델은 개발자에게 큰 도움이 됩니다. 하지만 같은 능력이 공격 자동화나 취약점 분석에 악용될 가능성도 함께 검토해야 합니다. 이것은 특정 모델이 위험하다고 단정하는 말이 아닙니다. 강력한 기술일수록 좋은 활용과 나쁜 활용이 동시에 가능하므로, 출시 전에 그 경계를 확인해야 한다는 뜻입니다.

Google DeepMind도 고도화된 AI의 사이버 보안 위협 평가를 다룬 글에서, AI 모델이 발전하면 사이버 공격을 자동화하거나 가속할 가능성을 평가해야 한다고 설명했습니다. 핵심은 공포를 키우자는 것이 아니라, 모델 능력이 커지는 속도에 맞춰 평가 방식도 달라져야 한다는 점입니다.

이때 등장하는 개념이 출시 전 평가입니다. 제품을 공개하기 전에 위험한 사용 가능성, 안전장치 우회 가능성, 도구 연결 시 권한 문제, 배포 후 변화 가능성을 미리 점검하는 절차입니다. 기존 소프트웨어의 보안 리뷰와 비슷하지만, AI에서는 “모델이 무엇을 할 수 있는가”까지 평가 대상에 들어갑니다.

AI 레드팀도 같은 맥락입니다. 레드팀은 일부러 공격자처럼 생각하며 약점을 찾는 보안 점검 방식입니다. AI 레드팀은 모델이 금지된 요청, 우회 프롬프트, 위험한 자동화, 권한 경계 침범 상황에서 어떻게 반응하는지 확인합니다. 목적은 위험을 조장하는 것이 아니라, 실제 출시 전에 실패할 수 있는 지점을 먼저 찾아 줄이는 것입니다.

NIST 발표에서 언급된 제한된 환경의 테스트도 이 관점에서 이해할 수 있습니다. 안전장치가 줄어든 모델을 평가한다는 표현은 위험한 모델을 공개한다는 뜻이 아닙니다. 자동차 충돌 시험처럼, 실제 배포 전에 더 강한 조건에서 위험을 확인해 보겠다는 의미에 가깝습니다.

따라서 이번 흐름은 AI 산업의 경쟁 기준을 바꿉니다. 지금까지는 모델이 얼마나 빠른지, 얼마나 똑똑한지, 얼마나 저렴한지가 주된 비교 기준이었습니다. 앞으로는 여기에 “얼마나 안전하게 검증됐는가”, “문제가 생겼을 때 추적하고 대응할 수 있는가”가 함께 붙게 됩니다.

프론티어 AI 리스크가 허위정보와 편향뿐 아니라 사이버 보안, 고급 코드 작성, 취약점 탐지 보조, 자동화된 공격 가능성으로 확장되는 리스크 맵

비교 또는 구조화: 기존 보안 점검과 AI 모델 사전 평가는 무엇이 다른가

| 구분 | 기존 소프트웨어 보안 점검 | AI 모델 사전 보안 평가 |

|---|---|---|

| 주요 대상 | 코드, API, 인증, 권한, 서버 설정 | 모델 능력, 오용 가능성, 안전장치, 배포 후 행동 변화 |

| 핵심 질문 | 이 시스템에 취약점이 있는가? | 이 모델의 능력이 위험하게 쓰일 가능성이 있는가? |

| 평가 방식 | 코드 리뷰, 침투 테스트, 취약점 스캔 | 레드팀, 능력 평가, 안전장치 우회 테스트, 표적 연구 |

| 위험 유형 | 데이터 유출, 인증 우회, 서버 침해 | 공격 보조, 자동화된 오용, 안전장치 우회 가능성 |

| 배포 후 관리 | 패치, 로그 모니터링, 장애 대응 | 모델 업데이트 추적, 사용 패턴 감시, 위험 행동 재평가 |

이 표의 핵심은 간단합니다. AI 모델 사전 평가는 기존 보안 점검을 대체하는 것이 아닙니다. 기존 보안 점검 위에 “모델 능력과 행동을 평가하는 새로운 층”이 하나 더 생기는 것입니다.

AI가 단순히 답변만 생성할 때는 위험이 비교적 제한적일 수 있습니다. 하지만 AI가 코드를 작성하고, 내부 데이터를 검색하고, 도구를 호출하고, 업무 자동화에 연결되면 이야기가 달라집니다. 이때는 모델의 답변뿐 아니라 모델이 실제로 어떤 행동을 유도할 수 있는지도 함께 봐야 합니다.

실무적 의미: AI 도입 검토는 기능 비교에서 신뢰 검증으로 이동합니다

AI 서비스를 기획하거나 도입하는 기업 입장에서는 검토 기준이 넓어집니다. 지금까지는 모델 성능, 비용, 응답 속도, API 안정성, 기능 차별화가 중요했습니다. 앞으로는 여기에 안전성 평가 자료, 레드팀 결과, 취약점 신고 절차, 배포 후 모니터링 체계까지 함께 봐야 할 가능성이 큽니다.

특히 AI 모델을 내부 도구와 연결하는 경우에는 더 조심해야 합니다. 모델이 단순히 답변만 하는 것이 아니라, 사내 문서를 검색하거나 클라우드 리소스를 조작하거나 업무 시스템에 명령을 보내는 구조라면 보안 경계가 크게 넓어집니다. 이때는 최소 권한, 승인 절차, 감사 로그, 샌드박스 같은 장치가 함께 필요합니다.

AI 기업에게도 의미가 큽니다. 앞으로는 “우리 모델이 벤치마크에서 몇 점을 받았다”만으로는 충분하지 않을 수 있습니다. “우리 모델은 어떤 위험 평가를 거쳤고, 어떤 방식으로 배포 후 문제를 추적하며, 외부 검증에 어떻게 대응할 수 있는가”가 신뢰의 중요한 기준이 될 수 있습니다.

비전문 독자에게는 자동차 안전 검사에 비유하면 이해하기 쉽습니다. 자동차가 빠르다고 해서 바로 도로에 나올 수 있는 것은 아닙니다. 브레이크, 충돌 안전성, 리콜 체계가 필요합니다. 프론티어 AI 모델도 마찬가지입니다. 더 똑똑한 모델일수록 더 넓은 영역에서 쓰일 수 있지만, 그만큼 출시 전 검증과 배포 후 관리가 중요해집니다.

물론 정부 검토가 항상 좋은 방향으로만 작동한다고 단정할 수도 없습니다. 신뢰를 높일 수 있지만, 혁신 속도를 늦추거나 정치적 판단이 개입될 수 있다는 우려도 있습니다. 그래서 지금 단계에서 중요한 것은 찬반보다 흐름을 읽는 일입니다. AI 모델 배포의 기준이 “잘 작동하는가”에서 “검증 가능하고 통제 가능한가”로 넓어지고 있다는 점입니다.

결론: 앞으로는 잘하는 모델보다 검증 가능한 모델이 중요해집니다

AI 모델 출시 전 보안 검증은 단순한 규제 뉴스가 아닙니다. 프론티어 AI가 코드 작성, 보안 분석, 자동화, 공공 인프라, 기업 운영 시스템과 연결될수록 모델 배포는 점점 더 소프트웨어 릴리즈와 비슷한 보안 절차를 요구받게 됩니다.

NIST CAISI와 Google DeepMind, Microsoft, xAI의 협력은 이 변화를 보여주는 사례입니다. 공식 발표 기준으로 이 협력은 공개 전 평가뿐 아니라 배포 후 평가와 표적 연구까지 포함합니다. 이는 프론티어 AI 모델을 단순한 제품이 아니라 보안과 국가 안보 관점에서도 검토해야 할 기술로 보고 있다는 뜻입니다.

다만 백악관의 공식 정부 검토 절차는 아직 확정된 제도라고 쓰면 안 됩니다. 공개 자료 기준으로는 “검토 중인 정책 방향”이 더 정확합니다. 이 차이를 구분해야 글의 신뢰도가 유지됩니다.

결국 앞으로 AI 기업의 경쟁력은 모델 성능 하나로 설명되지 않을 것입니다. 빠르고 똑똑한 모델도 중요하지만, 출시 전 평가 체계, 레드팀, 보안 문서화, 배포 후 모니터링, 외부 검증 대응 능력을 갖춘 모델이 더 신뢰받을 가능성이 큽니다. AI 모델 배포의 다음 기준은 “얼마나 잘하는가”에서 “얼마나 검증 가능한가”로 이동하고 있습니다.

FAQ: AI 모델 출시 전 보안 검증에 대한 핵심 질문

Q. AI 모델 출시 전 정부 심사가 이미 의무화된 건가요?

공개 자료 기준으로 그렇게 단정할 수는 없습니다. NIST CAISI의 협력은 공식 발표됐지만, 백악관의 공식 정부 검토 절차는 아직 확정된 제도가 아니라 검토 중인 정책 방향으로 보는 것이 정확합니다.

Q. Microsoft, Google DeepMind, xAI가 특정 모델을 위험하다고 인정한 건가요?

아닙니다. 현재 확인되는 것은 공개 전 모델 평가 협력입니다. 특정 모델이 실제 공격을 수행했다거나 위험하다고 단정할 공개 근거는 없습니다.

Q. AI 모델 사전 평가는 기존 보안 점검과 무엇이 다른가요?

기존 보안 점검은 코드, 서버, 인증, 권한, 취약점을 주로 봅니다. AI 모델 사전 평가는 여기에 더해 모델의 능력, 오용 가능성, 안전장치 우회 가능성, 배포 후 행동 변화까지 봅니다.

Q. AI 레드팀은 무엇을 하나요?

AI 레드팀은 모델이 위험한 요청이나 우회 시도에 어떻게 반응하는지 테스트합니다. 목적은 위험을 조장하는 것이 아니라, 출시 전에 실패할 수 있는 지점을 찾아 줄이는 것입니다.

Q. 기업이 AI 모델을 도입할 때 앞으로 무엇을 봐야 하나요?

성능과 가격뿐 아니라 안전성 평가 자료, 레드팀 결과, 취약점 신고 체계, 배포 후 모니터링, 외부 검증 대응 능력을 함께 보는 것이 중요해질 수 있습니다.