핵심 요약

- Mistral Medium 3.5와 Vibe remote agents 발표는 단순히 새 모델이 나왔다는 소식보다, 기업이 AI를 어디에서 실행하고 어떻게 통제할 것인가를 보여주는 사례에 가깝습니다.

- 폐쇄형 API는 빠르게 시작하기 좋지만, 내부 코드·문서·업무 도구를 AI 에이전트가 다루기 시작하면 데이터가 어디로 흐르는지, 어떤 권한을 주는지가 더 중요해집니다.

- 오픈웨이트와 self-hosted 전략은 폐쇄형 API를 완전히 대체하는 답이 아닙니다. 대신 민감한 업무, 비용 예측, 벤더 종속성 완화가 필요한 조직에 또 하나의 선택지를 제공합니다.

- 중요한 것은 “어떤 모델이 가장 똑똑한가”만이 아닙니다. 앞으로는 “AI가 어떤 환경에서, 어떤 데이터와 권한을 가지고 실행되는가”가 기업 AI 전략의 핵심 질문이 됩니다.

목차

- 먼저 답부터: 모델 성능 경쟁은 배포 통제권 경쟁으로 확장됩니다

- 사실 확인: public preview, 벤치마크, 라이선스 조건을 구분해야 합니다

- 핵심 내용 설명: 모델·원격 에이전트·Work Mode가 하나의 실행 전략으로 묶입니다

- 비교 또는 구조화: closed API와 self-hosted 전략은 업무별로 나눠 봐야 합니다

- 실무적 의미: AI 에이전트 도입의 핵심은 실행 경계와 권한 설계입니다

- 체크리스트: 라이선스, 데이터 위치, GPU 비용, 권한 정책을 먼저 점검해야 합니다

- 결론: 오픈웨이트의 반격은 성능 승부가 아니라 통제권 의제의 부상입니다

- FAQ: Mistral Medium 3.5, Vibe, Work Mode 도입 전 자주 묻는 질문

먼저 답부터: 모델 성능 경쟁은 배포 통제권 경쟁으로 확장됩니다

이번 Mistral 발표의 핵심은 “오픈웨이트 모델이 폐쇄형 모델을 이겼다”가 아닙니다. 더 정확히는 AI 경쟁의 무게중심이 모델 성능만이 아니라 배포 통제권으로 넓어지고 있다는 점입니다.

지금까지 많은 기업은 OpenAI, Anthropic, Google 같은 외부 AI API를 붙여 빠르게 실험했습니다. 이 방식은 여전히 유용합니다. 별도로 GPU를 운영하지 않아도 되고, 최신 모델을 빠르게 쓸 수 있으며, 모델 업데이트와 서버 운영 부담도 줄어듭니다.

하지만 AI 에이전트가 단순한 답변 생성기를 넘어 내부 코드 저장소, 문서, 이메일, 캘린더, 이슈 트래커, 배포 도구까지 다루기 시작하면 질문이 달라집니다. “어떤 모델이 더 똑똑한가?”만큼이나 “이 모델은 어디에서 실행되는가?”, “우리 데이터는 외부로 나가는가?”, “AI가 어떤 작업까지 할 수 있는가?”가 중요해집니다.

Mistral Medium 3.5와 Vibe remote agents가 주목받는 이유도 여기에 있습니다. Mistral은 모델, 코딩 에이전트, Work Mode, 배포 선택지를 함께 제시했습니다. 이는 단순히 모델 하나를 공개한 것이 아니라, 기업이 AI를 더 통제 가능한 방식으로 활용할 수 있다는 메시지에 가깝습니다.

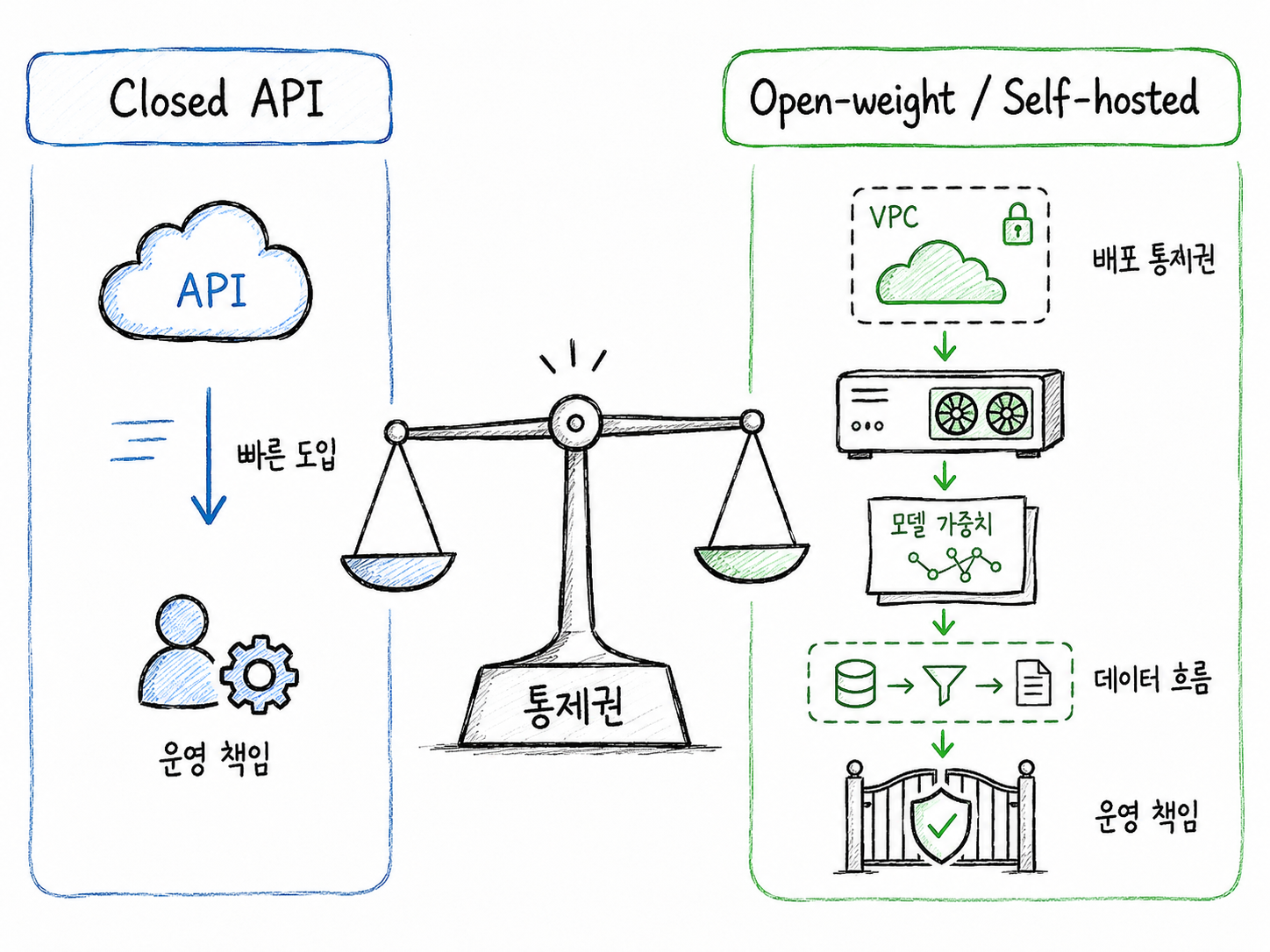

폐쇄형 API와 오픈웨이트 셀프호스팅 전략을 비교하며, 빠른 도입과 배포 통제권·데이터 흐름·운영 책임의 차이를 보여주는 개념도

사실 확인: public preview, 벤치마크, 라이선스 조건을 구분해야 합니다

이번 글에서 확인해야 할 사실은 많지 않습니다. 핵심만 보면 됩니다. Mistral은 2026년 4월 29일 Mistral Medium 3.5, Vibe remote agents, Le Chat Work Mode를 함께 소개했습니다.

Mistral Medium 3.5는 공개 자료 기준 public preview 상태의 128B dense 모델입니다. Mistral은 이 모델이 instruction-following, reasoning, coding을 함께 처리하고, open weights와 self-hosting 가능성을 제공한다고 설명합니다.

다만 “오픈웨이트”를 “아무 기업이나 제한 없이 자유롭게 쓰는 완전한 오픈소스”로 이해하면 곤란합니다. Mistral Medium 3.5는 Modified MIT License로 소개되어 있으며, 일정 규모 이상의 기업 사용에는 제한 조건이 있습니다. 기업 도입 전에는 반드시 라이선스를 별도로 검토해야 합니다.

또한 Vibe Code Workflow와 Le Chat Work Mode는 모두 Preview로 표시되어 있습니다. 따라서 현재의 기능, 사용 가능 범위, 제한 조건은 이후 달라질 수 있습니다. 이 글에서는 이를 정식 일반 출시가 아니라 단계적 제공 중인 흐름으로 보는 것이 안전합니다.

벤치마크 수치도 참고 지표일 뿐입니다. 실제 기업 도입에서는 우리 회사의 코드베이스, 내부 문서, 보안 정책, 비용 기준, 리뷰 방식에 맞춰 별도로 검증해야 합니다.

핵심 내용 설명: 모델·원격 에이전트·Work Mode가 하나의 실행 전략으로 묶입니다

AI 모델을 쓰는 방식은 크게 두 가지로 나눠볼 수 있습니다. 하나는 외부 기업이 운영하는 AI 모델을 API로 빌려 쓰는 방식입니다. 이를 여기서는 폐쇄형 API 중심 전략이라고 부르겠습니다. 다른 하나는 모델 가중치가 공개된 모델을 직접 내려받아, 자체 서버나 클라우드 안에서 운영하는 방식입니다. 이를 open-weight 또는 self-hosted 전략이라고 볼 수 있습니다.

폐쇄형 API는 빠릅니다. 개발자는 API 키를 받고 SDK를 붙이면 바로 실험할 수 있습니다. 반면 self-hosted 방식은 더 복잡합니다. GPU가 필요하고, 모델을 서빙하는 엔진이 필요하며, 장애 대응과 보안 패치도 직접 챙겨야 합니다.

그런데도 기업이 open-weight와 self-hosted 전략을 검토하는 이유는 명확합니다. AI가 점점 더 민감한 업무 영역으로 들어오고 있기 때문입니다. 단순한 문장 생성이라면 외부 API를 써도 부담이 적을 수 있습니다. 하지만 AI가 내부 소스코드를 읽고, 고객 데이터를 참고하고, 업무 도구를 조작하고, PR까지 만든다면 이야기가 달라집니다.

이때 기업은 모델 성능뿐 아니라 실행 위치와 권한을 봐야 합니다. AI가 회사 내부망 안에서 실행되는지, 외부 API로 어떤 데이터가 전송되는지, 어떤 명령은 자동 실행되고 어떤 명령은 사람 승인이 필요한지 정해야 합니다. 즉, AI 도입은 모델 선택 문제가 아니라 실행 환경 설계 문제가 됩니다.

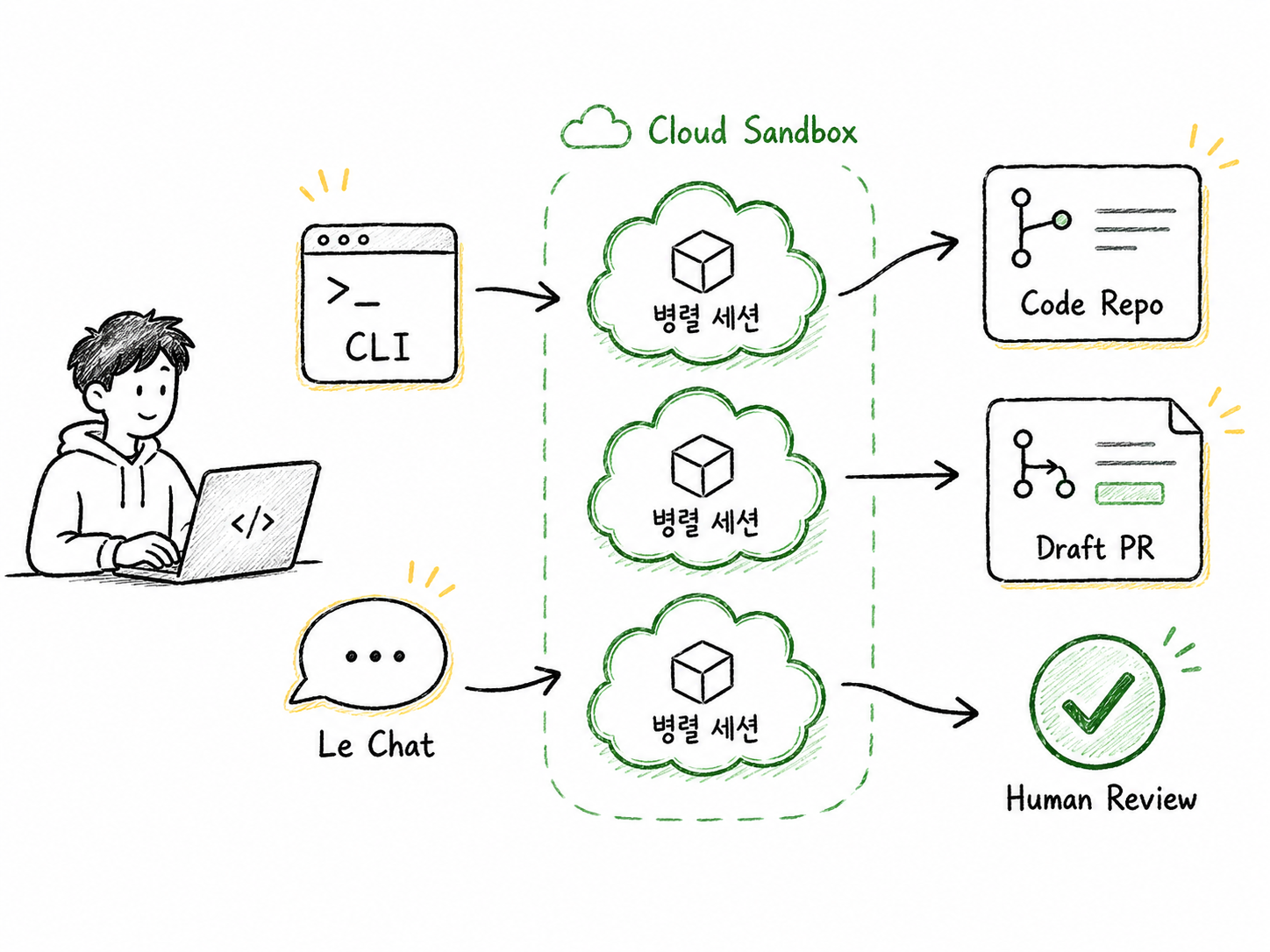

개발자가 CLI 또는 Le Chat에서 코딩 작업을 시작하면 클라우드 샌드박스의 병렬 세션에서 실행되고 Draft PR과 사람 리뷰로 이어지는 Vibe remote agent 워크플로우

Mistral Vibe는 이 변화를 잘 보여줍니다. 로컬 터미널에서만 AI 코딩 도구를 쓰는 것이 아니라, 클라우드 샌드박스에서 여러 작업을 비동기로 실행하고, 결과를 Draft PR 형태로 검토하는 흐름을 제시합니다. 개발자가 AI에게 일을 맡기고, 결과물을 사람의 리뷰 절차로 가져오는 구조입니다.

다만 Vibe remote agents를 self-hosted agent라고 단정하면 안 됩니다. 공식 문서 기준 Vibe Code Workflow는 Mistral의 cloud sandbox에서 실행되는 remote coding agent입니다. 즉, “원격으로 실행되는 에이전트”와 “기업이 직접 운영하는 에이전트”는 구분해야 합니다.

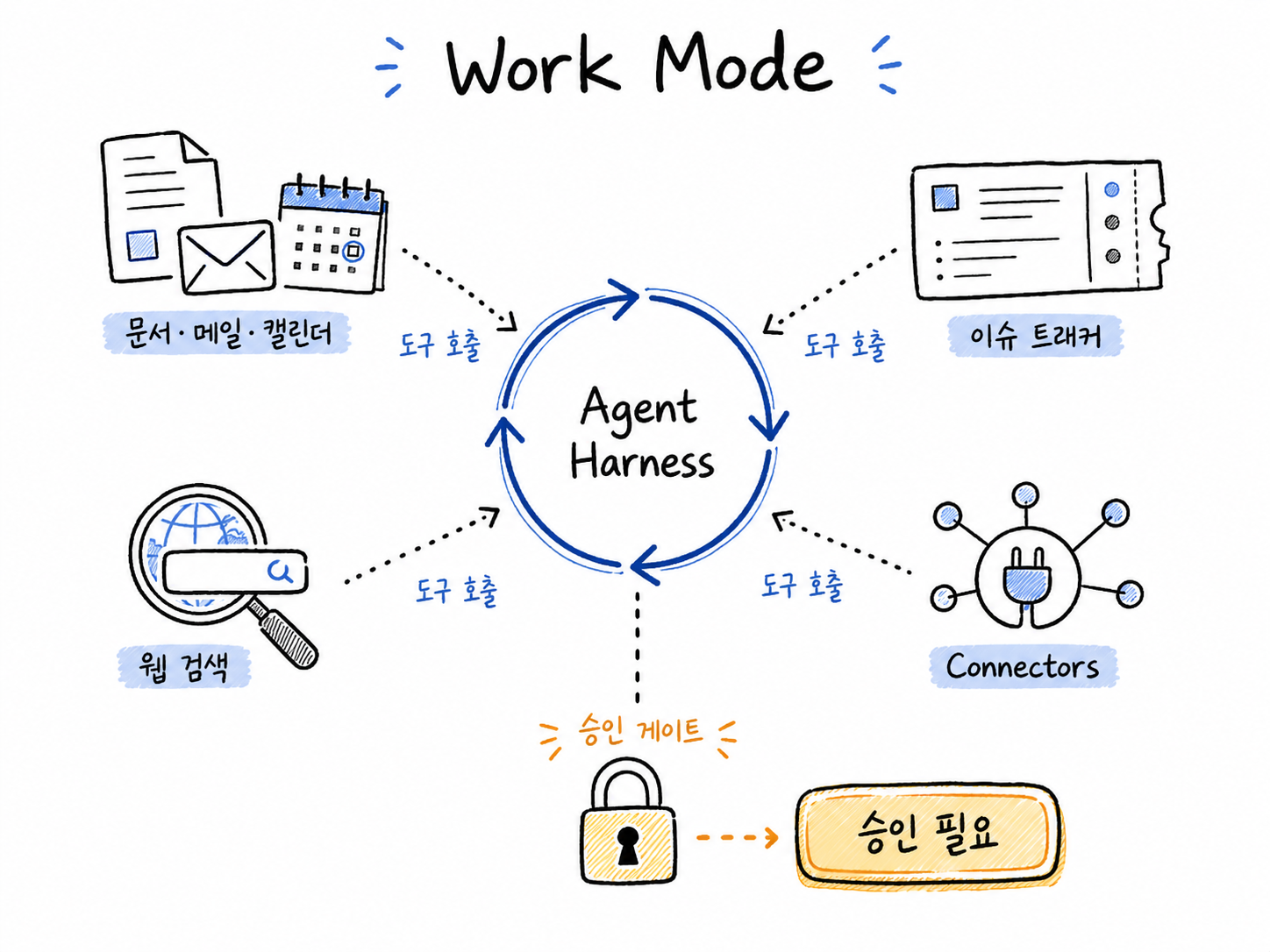

Le Chat Work Mode도 같은 흐름에 있습니다. 일반 채팅처럼 질문에 답하는 데 그치지 않고, 문서·메일·캘린더·이슈 트래커 같은 도구를 연결해 여러 단계의 업무를 처리하는 방향을 보여줍니다. AI가 답변만 하는 것이 아니라 업무 흐름 안으로 들어오기 시작한 것입니다.

Le Chat Work Mode가 문서·메일·캘린더·이슈 트래커 같은 커넥터와 도구를 사용해 멀티스텝 업무를 수행하는 에이전트 하네스 구조를 보여주는 개념도

비교 또는 구조화: closed API와 self-hosted 전략은 업무별로 나눠 봐야 합니다

| 관점 | 폐쇄형 API | 오픈웨이트 / 직접 운영 | 읽어야 할 의미 |

|---|---|---|---|

| 도입 속도 | API 연결만으로 빠르게 시작하기 쉽습니다. | GPU, 서빙 환경, 운영 체계가 필요합니다. | 초기 실험은 API가 빠르고, 민감 업무는 직접 운영을 검토할 수 있습니다. |

| 데이터 통제 | 외부 공급자의 보안 정책에 의존합니다. | 모델 실행 위치와 데이터 흐름을 내부에서 설계할 수 있습니다. | 소스코드, 고객정보, 운영 로그처럼 민감한 데이터일수록 중요합니다. |

| 비용 구조 | 토큰 사용량에 따라 비용이 늘어납니다. | GPU와 운영 인력 비용이 먼저 필요합니다. | 단순 단가가 아니라 사용량, 지연 시간, 운영 난이도를 함께 봐야 합니다. |

| 운영 책임 | 모델 운영 부담을 공급자에게 맡길 수 있습니다. | 성능 최적화, 장애 대응, 보안 패치를 직접 관리해야 합니다. | 운영 역량이 부족하면 직접 운영이 더 비싸고 복잡해질 수 있습니다. |

| 전략적 유연성 | 특정 API와 도구 체인에 묶일 수 있습니다. | 모델 교체와 내부 최적화 여지를 가질 수 있습니다. | 장기적으로는 벤더 종속성을 줄이는 선택지가 될 수 있습니다. |

실무적 의미: AI 에이전트 도입의 핵심은 실행 경계와 권한 설계입니다

실무에서 중요한 결론은 하나입니다. 앞으로 기업은 AI 모델을 하나의 방식으로만 쓰기 어렵습니다. 빠른 실험과 일반 업무 자동화에는 폐쇄형 API가 효율적일 수 있습니다. 반면 내부 코드, 고객 데이터, 운영 로그, 규제 대상 업무처럼 민감도가 높은 영역에서는 직접 운영하거나 더 통제 가능한 실행 환경을 검토해야 합니다.

백엔드 개발자나 플랫폼 엔지니어 관점에서는 모델 성능보다 실행 경계가 중요해집니다. AI 에이전트가 저장소를 읽고, 테스트를 돌리고, 브랜치를 만들고, PR까지 생성한다면 “AI가 어디까지 할 수 있는가”를 명확히 정해야 합니다. 읽기만 가능한 작업, 수정 가능한 작업, 사람 승인이 필요한 작업을 구분하지 않으면 편리함이 곧 운영 리스크가 될 수 있습니다.

또한 AI 에이전트는 비용과 관측성 측면에서도 새로운 관리 대상입니다. 여러 세션이 동시에 실행되면 토큰 비용뿐 아니라 세션 시간, 실패한 명령, 권한 오류, PR 생성 실패, 재시도 횟수 같은 지표도 봐야 합니다. AI가 업무를 대신 실행할수록 로그와 승인 기록은 더 중요해집니다.

기술 의사결정자에게 필요한 질문도 바뀝니다. “어떤 모델을 쓸 것인가?”보다 “어떤 업무는 외부 API로 처리하고, 어떤 업무는 내부 실행 환경으로 분리할 것인가?”가 더 현실적인 질문입니다. Mistral Medium 3.5와 Vibe remote agents는 이 질문을 다시 떠올리게 만든 사례입니다.

체크리스트: 라이선스, 데이터 위치, GPU 비용, 권한 정책을 먼저 점검해야 합니다

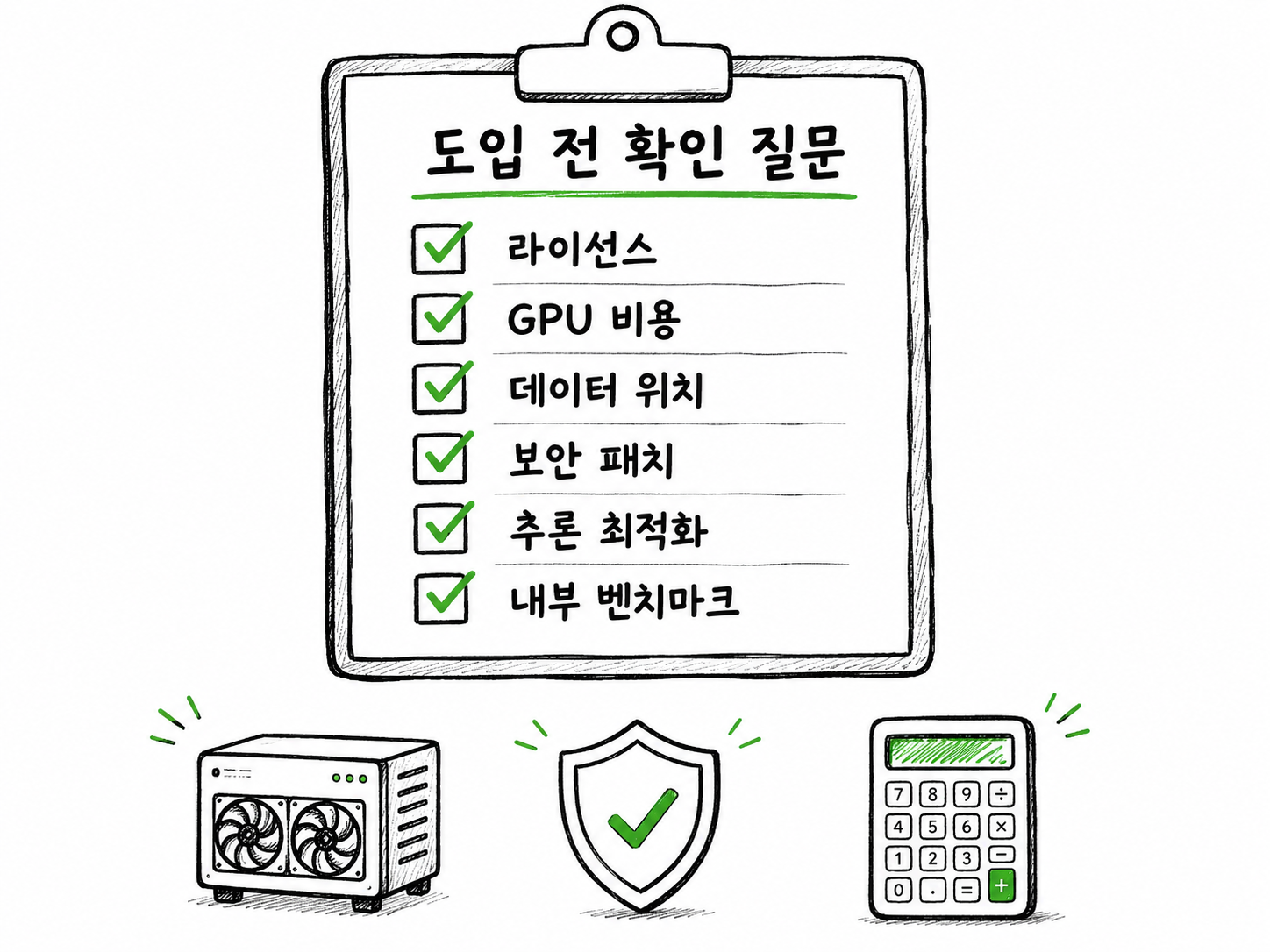

오픈웨이트나 self-hosted AI 에이전트를 검토할 때는 모델 성능표만 보면 부족합니다. 실제 도입 전에 아래 항목을 먼저 점검해야 합니다.

- 모델 라이선스가 회사 규모와 사용 목적에 맞는지 확인했는가?

- 외부 API로 보내도 되는 데이터와 내부에서만 처리해야 하는 데이터를 구분했는가?

- GPU 비용, 운영 인력, 장애 대응, 보안 패치 부담을 계산했는가?

- AI 에이전트가 읽기, 수정, 실행, PR 생성 중 어디까지 할 수 있는지 정했는가?

- 사람 승인이 필요한 작업과 자동화해도 되는 작업을 분리했는가?

- 공식 벤치마크가 아니라 내부 코드베이스와 실제 업무 데이터로 따로 검증했는가?

- 세션 로그, 도구 호출 로그, 비용 로그, 변경 이력을 추적할 수 있는가?

기업이 오픈웨이트 또는 셀프호스팅 AI 에이전트를 도입하기 전 라이선스, GPU 비용, 데이터 위치, 보안 패치, 추론 최적화, 내부 벤치마크를 점검하는 체크리스트

결론: 오픈웨이트의 반격은 성능 승부가 아니라 통제권 의제의 부상입니다

Mistral Medium 3.5와 Vibe remote agents 발표는 “새로운 AI 모델이 하나 더 나왔다”는 소식으로만 보기 어렵습니다. 더 중요한 메시지는 기업 AI 전략이 모델 API 호출을 넘어 실행 환경, 권한, 데이터 흐름, 배포 통제권으로 확장되고 있다는 점입니다.

폐쇄형 API는 여전히 강력합니다. 빠르게 시작할 수 있고, 최신 모델을 쉽게 사용할 수 있으며, 운영 부담도 줄일 수 있습니다. 그러나 AI 에이전트가 내부 업무 도구를 직접 다루는 단계로 들어가면, 기업은 편리함만으로 판단하기 어렵습니다.

오픈웨이트와 self-hosted 전략은 만능 해결책이 아닙니다. GPU 비용, 운영 인력, 보안 패치, 라이선스 검토라는 부담이 있습니다. 그럼에도 이 선택지가 다시 주목받는 이유는 분명합니다. AI가 업무 실행 계층으로 들어올수록, 기업은 모델 성능뿐 아니라 모델이 어디서 실행되고 어떤 데이터를 다루는지 통제해야 하기 때문입니다.

따라서 이번 흐름은 “오픈웨이트가 폐쇄형 API를 이겼다”가 아니라 “기업 AI 도입에서 배포 통제권이 다시 핵심 의제가 됐다”는 신호로 읽는 편이 정확합니다.

FAQ: Mistral Medium 3.5, Vibe, Work Mode 도입 전 자주 묻는 질문

Q. 오픈웨이트 AI는 오픈소스 AI와 같은 뜻인가요?

항상 같지는 않습니다. 오픈웨이트는 모델의 가중치가 공개되었다는 의미에 가깝습니다. 하지만 사용 조건, 상업적 이용 가능 범위, 기업 규모 제한은 라이선스마다 다를 수 있습니다.

Q. Mistral Medium 3.5는 기업이 바로 자유롭게 써도 되나요?

단정하면 안 됩니다. Mistral Medium 3.5는 Modified MIT License로 소개되어 있지만, 일정 규모 이상의 기업 사용에는 제한 조건이 포함되어 있습니다. 기업 도입 전에는 법무 검토가 필요합니다.

Q. Vibe remote agents는 self-hosted agent인가요?

아닙니다. 공식 문서 기준 Vibe Code Workflow는 Mistral의 cloud sandbox에서 실행되는 remote coding agent입니다. 원격 실행과 직접 운영은 구분해서 이해해야 합니다.

Q. 기업은 closed API와 self-hosted 모델 중 하나만 선택해야 하나요?

그렇지 않습니다. 빠른 실험과 일반 업무에는 closed API가 적합할 수 있고, 민감 데이터나 내부 코드처럼 통제가 중요한 업무에는 self-hosted 전략을 검토할 수 있습니다. 핵심은 업무의 민감도에 따라 실행 경로를 나누는 것입니다.

Q. 이번 발표에서 가장 중요한 인사이트는 무엇인가요?

AI 경쟁이 모델 성능 경쟁을 넘어 배포 통제권 경쟁으로 확장되고 있다는 점입니다. 앞으로 기업은 모델의 성능뿐 아니라 데이터 흐름, 실행 위치, 권한, 비용, 라이선스를 함께 봐야 합니다.